Нейросеть помогает мошенникам красть голоса

На днях стало известно, что сотрудник одной из западных IT-компаний стал слабым звеном в безопасности своего работодателя, позволив хакеру получить доступ к закрытой информации. На него вышел электронный мошенник: злоумышленник смог с помощью нейросети подделать голос знакомого айтишника, который якобы пытался решить вопрос с выплатой заработной платы и страховки. В итоге доверчивый сотрудник предоставил обладателю знакомого голоса свой ключ аутентификации, с помощью которого компьютерный преступник проник внутрь IT-инфраструктуры компании.

Как рассказал Metro актёр театра, кино и дубляжа, озвучивший известного голливудского актёра в нескольких фильмах и пожелавший остаться неназванным, он сам стал жертвой мошенничества с использованием искусственного интеллекта.

– Друзья сказали: "Ого, ты тиктоки озвучиваешь!". А я никогда таким не занимался. Потом мне прислали пару роликов на "Ютубе", которые я тоже не писал, – вспоминает собеседник. – Я ругнулся в сердцах, злой ходил неделю, начал копать, нашёл сайт, который делал озвучку моим голосом, но у них не было обратной связи. Я знаю, что уже сейчас такими сворованными голосами озвучивают свои ролики на "Ютубе" те, кто не в состоянии хорошо прочитать текст за кадром. Конечно, это потенциальные убытки для актёров дубляжа.

Но потенциальный вред от применения нейросетей в генерации лиц и голосов гораздо шире, чем нарушение авторских прав.

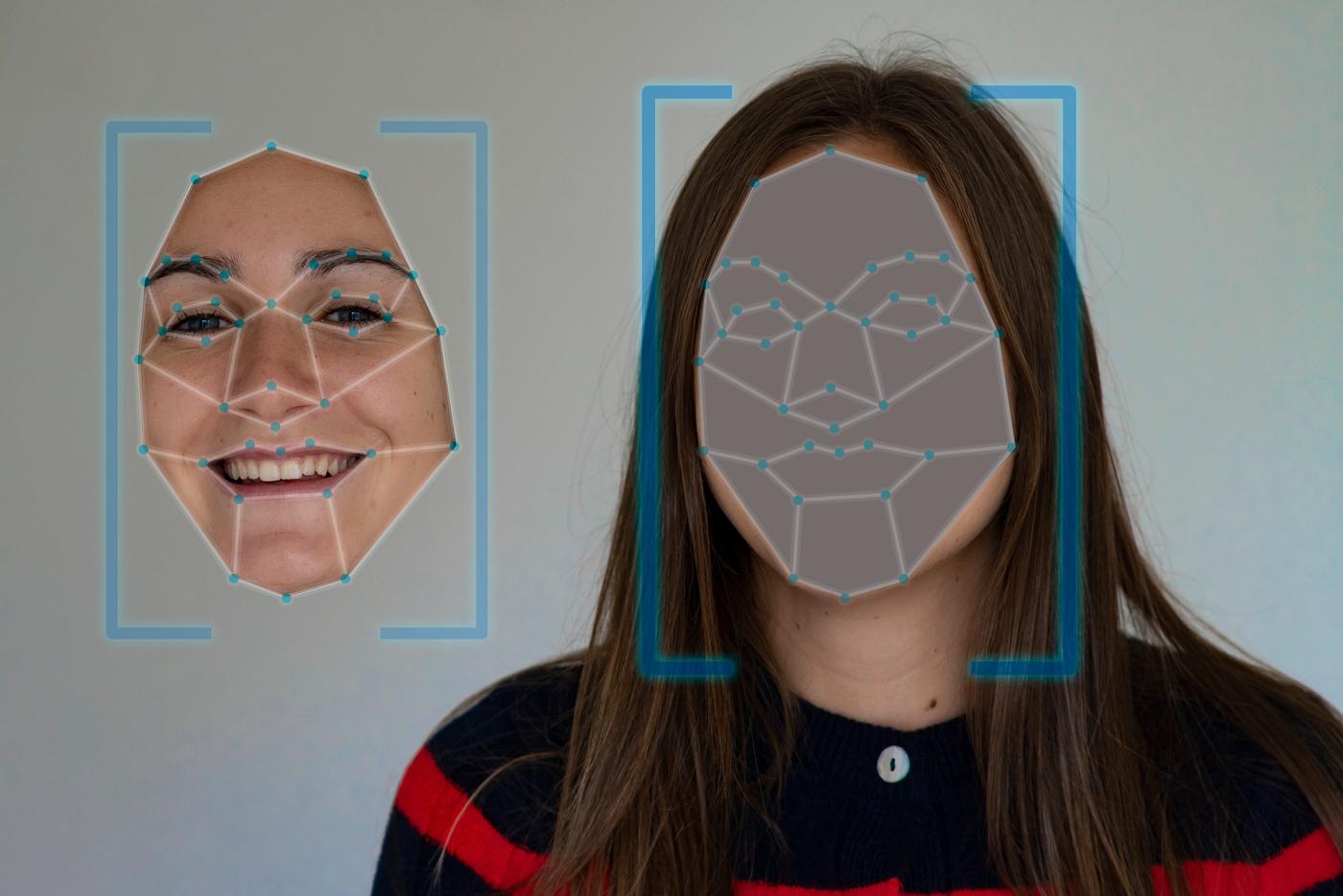

Обман нейросети: распознавание образов и голосов

Эксперт по информационной безопасности Ассоциации "Информационная безопасность банков" Денис Батранков обратил внимание, что сейчас банки видят усиление тенденции по применению мошеннических схем с использованием синтеза голосов и лиц.

Менее распространено создание 3D-маски человека. Мошенник может подождать, пока жертва отвлечётся от телефона, отсканировать её смартфоном "маску", синтезированную ИИ на основе фото жертвы из соцсети, и получить доступ к финансовым приложениям человека в телефоне.

Кол-центры обманывают людей с помощью искусственного интеллекта

Председатель совета Ассоциации цифровой трансформации Юрий Мышинский подчеркнул, что сегодня мошенничество с использованием ИИ развивается не только в банковском секторе, но также в медицине и в сфере продаж.

– Есть кол-центры мошеннические, они тестируют новые технологии: с помощью ИИ можно убрать лишние шумы кол-центра, создавать "роботов", на которых "оператор" может переключить своего собеседника для ввода номера карты или других конфиденциальных данных, – предупредил эксперт.

Он прогнозирует, что мошенники в ближайшем будущем смогут полностью копировать сценарии, звуковые заставки и даже стиль общения сотрудников банков.

Война машин

Однако IT-компании и службы безопасности банков пытаются придумать противоядие. Разрабатывается софт, чтобы отличить мошенника от добросовестного человека.

– Мы применяем ИИ против ИИ, и банки внедряют такие технологии, они способны отличить секретаршу директора от хакера, действующего как секретарша директора. К примеру, реальная секретарша обычно работает в программе Word, а тут вдруг видно, что она начинает настраивать маршрутизаторы компании, что ей несвойственно. Текстуры изображения могут быть странноваты, объекты могут не сочетаться с фото и видео, ИИ способен сам увидеть эти странности, – сказал Денис Батранков.

Как защититься от мошенников?

- Можно воспользоваться услугой защиты от спама и мошенников от операторов мобильной связи, это первая линия обороны, говорит Юрий Мышинский.

- Если вам позвонили даже с известного номера и просят предоставить любую чувствительную информацию, касающуюся ваших персональных данных, финансов, родственников, можно уточнить ФИО и должность сотрудника, попросить уточнить, на какой номер можно перезвонить (рабочий, не мобильный), а также проверить этот номер телефона через поисковую систему или сразу позвонить на официальный телефон организации.

- Хорошим вариантом будет личный визит в филиал банка или организации.

- Стоит обратить внимание на психологические уловки: если вас торопят, щеголяют громкими должностями или организациями, дают инструкции о том, что нужно совершить какие-то операции в банкомате или сообщить коды, сразу отказывайтесь от общения и звоните на официальный телефон вашего банка.